Möglichkeiten der Linsenchirurgie erlebbar machen.

Die gemeinsamen Projekte sind geprägt von starkem Innovationswillen und entsprechender Innovationskraft – auf Kundenseite und bei uns. Die Bereitschaft noch nie eingesetzte Technologien zu testen, um aufschlussreiche Erlebnisse zu schaffen, ermöglicht ein gemeinsames Forschen, Lernen und dadurch echte Weiter- und Neuentwicklungen.

Beide Seiten wissen, dass kein Laie die komplexen Prozesse im Auge verstehen kann, wenn er nur eine trockene Erklärung liest. Stattdessen müssen Patient:innen *selbst* sehen, immersiv erleben und interaktiv spielerisch ausprobieren, wie sich 1stQs Linsen auf ihr Sehvermögen auswirken – in realer und virtueller Welt, mit den passenden Technologien, so einfach verständlich und intuitiv nachvollziehbar wie möglich.

💡 Wie wir diese Aufgabe in einem iterativen Prozess umgesetzt haben – immer in enger Fachabstimmung mit 1stQ – beleuchten wir in dieser Use-Case Spotlight Serie.

Unsere Aufgabe:

🎬 Erste gemeinsame interaktive Webanwendung: Optimales Natürliches Sehen (ONS) & Grauer Star.

Unser Lösungsansatz:

Im Zuge unserer Zusammenarbeit haben wir verschiedene didaktische Methoden getestet, um die Linsen für diverse Zielgruppen erlebbar zu machen. Die erste Webanwendung präsentiert eine interaktive Story und holt die Betrachter:innen mit beeindruckenden Panorama-Aussichten und stimmungsvoller Cello-Musik auf emotionaler und intellektueller Ebene ab.

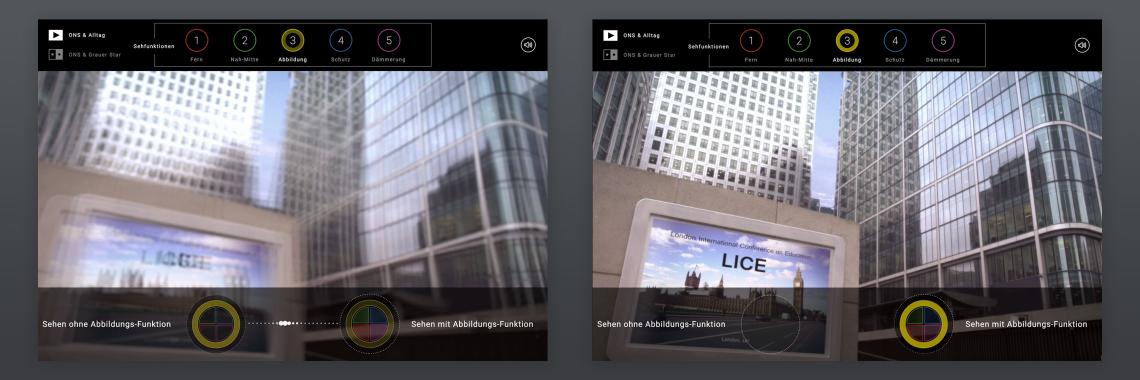

Wir zeigen in fünf Videosequenzen welche unterschiedlichen Funktionen die natürliche Augenlinse für unser Sehen erfüllt. Jede Funktion kann direkt selbst ausprobiert werden, indem ein Schieberegler langsam von links nach rechts bewegt wird.

Ein Businessman reist mit dem Auto nach London, macht Sightseeing, besucht eine Konferenz und lässt den Abend an der Themse zu Cello-Klängen ausklingen. An jeder dieser narrativen Stationen wird ein Faktor seiner Sicht korrigiert – spielerisch, durch die Nutzer:innen der Webanwendung, die dazu eine Linse mit dem Mauszeiger verschieben.

So wird zum Beispiel vor dem Conference Center die verzerrte Sicht korrigiert, und abends am dunklen Themse-Ufer die Nachtsicht wiederhergestellt – damit wir die auf der Bank sitzende Cellistin, die für den stimmungsvollen Promenaden-Soundtrack sorgt, nicht nur hören, sondern auch sehen können.

🤯 Behind-the-Scenes Facts

🎬 Die Videos für die Webanwendung wurden vor Ort in London gedreht, mit einem professionellen Regisseur und Kameramann.

🌒 Das Videomaterial vom Themse-Ufer haben wir bei Tag gedreht – und in der Postproduktion für die Visualisierung der Dämmerungsfunktion digital den Tag zur Nacht gemacht. Damit dies realistisch aussieht, haben wir die Uferlaternen digital modelliert, um die von ihnen ausgehende Beleuchtung richtig in Szene zu setzen.

🧑💻 Im Standbild ist die menschliche Sehunschärfe mit der richtigen Kombination an digitalen Tools und Wissen über den Aufbau des menschlichen Auges realistisch nachbaubar. In einem Video, Kamera, war das jedoch eine besondere Herausforderung, die wir mit speziellen von uns dafür programmierten Tools – AfterEffects konnte das nicht – und integriertem technischen Ansatz gelöst haben.

⁉️ Detailverliebtheit? Nein: Detailnotwendigkeit!

Immersion ist fragil. Wenn ein Film unrealistisch aussieht, verlieren Zuschauer:innen schnell das Interesse und schalten ab. Deshalb ist es besonders wichtig, Details wie Unschärfe und Beleuchtung authentisch darzustellen – und das wissen Rüdiger Dworschak und Prof. Dr. Sina Mostafawy ganz genau.

🤝 Darum sind RMH MEDIA und 1stQ ein Perfect Match und produzieren gemeinsam innovative Lösungen an der Schnittstelle von Wissenschaftskommunikation, Marketing, Technologie und Ästhetik.

Wir freuen uns, in den nächsten Wochen weitere Beispiele unserer Zusammenarbeit zu präsentieren!

Link zu Webanwendung:

Dieser Use-Case hat Sie inspiriert?

Wir beantworten gerne Fragen zu den Projekten und freuen uns über Ihr Feedback. Lassen Sie uns über Kommunikationslösungen für Ihre individuelle Content-Strategien sprechen.